多層前饋網(wǎng)絡(luò)(Multi-Layer Feedforward Network)是深度學(xué)習(xí)中最基本且被廣泛應(yīng)用的神經(jīng)網(wǎng)絡(luò)架構(gòu)之一。它構(gòu)成了人工智能基礎(chǔ)軟件開發(fā)的核心組件,尤其在模式識別、分類和回歸任務(wù)中發(fā)揮關(guān)鍵作用。

多層前饋網(wǎng)絡(luò)的結(jié)構(gòu)

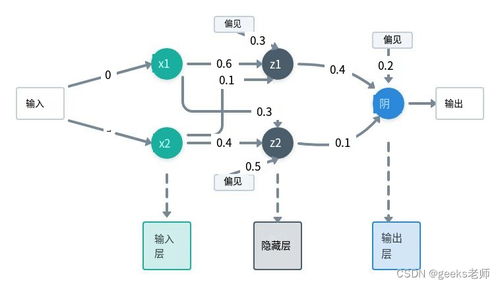

多層前饋網(wǎng)絡(luò)由輸入層、一個(gè)或多個(gè)隱藏層以及輸出層組成。這些層之間通過權(quán)重連接,但信息只從輸入層流向輸出層,沒有循環(huán)或反饋連接。輸入層接收原始數(shù)據(jù),隱藏層執(zhí)行非線性變換,輸出層生成最終結(jié)果。例如,一個(gè)簡單的多層前饋網(wǎng)絡(luò)可能包括輸入層(如像素值)、隱藏層(使用激活函數(shù)如ReLU處理數(shù)據(jù))和輸出層(如分類概率)。

工作原理與訓(xùn)練過程

在多層前饋網(wǎng)絡(luò)中,數(shù)據(jù)通過前向傳播進(jìn)行處理:輸入數(shù)據(jù)經(jīng)過加權(quán)和偏置后,應(yīng)用激活函數(shù)(如Sigmoid或Tanh)傳遞到下一層。誤差通過反向傳播算法進(jìn)行最小化,使用梯度下降優(yōu)化權(quán)重。訓(xùn)練中,損失函數(shù)(如均方誤差)衡量預(yù)測與真實(shí)值的差距,并通過迭代更新參數(shù)來提高模型精度。

在人工智能基礎(chǔ)軟件開發(fā)中的應(yīng)用

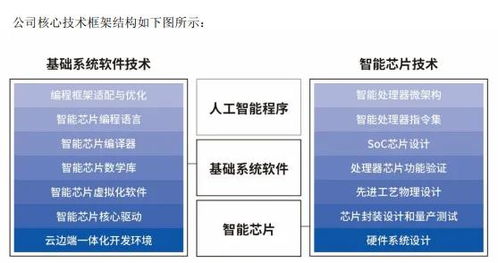

多層前饋網(wǎng)絡(luò)是許多AI應(yīng)用的基礎(chǔ),例如圖像識別、自然語言處理和預(yù)測分析。在軟件開發(fā)中,開發(fā)者可以使用框架如TensorFlow或PyTorch快速構(gòu)建和訓(xùn)練這類網(wǎng)絡(luò)。通過調(diào)整隱藏層數(shù)量、神經(jīng)元數(shù)和學(xué)習(xí)率,可以優(yōu)化模型性能,避免過擬合。

掌握多層前饋網(wǎng)絡(luò)是深入學(xué)習(xí)人工智能的關(guān)鍵一步。它為復(fù)雜模型(如卷積神經(jīng)網(wǎng)絡(luò))奠定了基礎(chǔ),并幫助開發(fā)者理解數(shù)據(jù)如何在網(wǎng)絡(luò)中流動(dòng)和轉(zhuǎn)換。在后續(xù)章節(jié)中,我們將探討更高級的神經(jīng)網(wǎng)絡(luò)架構(gòu)。